كيف وقع محرك بحث يوتيوب في فخ العنصرية ؟!

محرك بحث يوتيوب اعتاد أن يعرض مجموعة من الاقتراحات مع كتابة أول حرف، وهذه الاقتراحات لها علاقة بذلك الحرف أو الكلمة، فعند كتابة الحرف "أ" من الطبيعي أن يظهر لك ضمن الاقتراحات "أمل"، وعند كتابة "دبي" من الطبيعي أن يظهر لك ضمن الاقتراحات "السياحة في دبي".

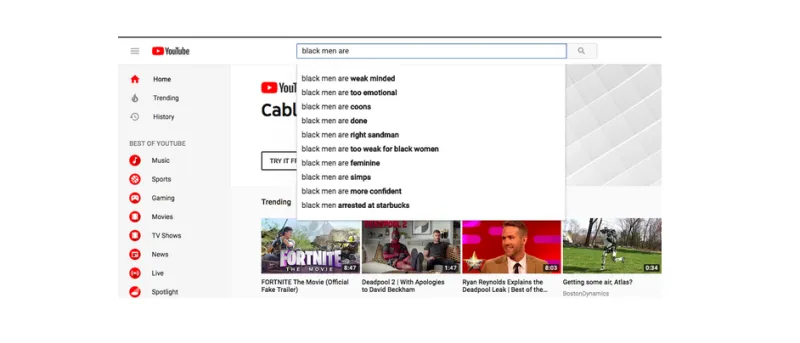

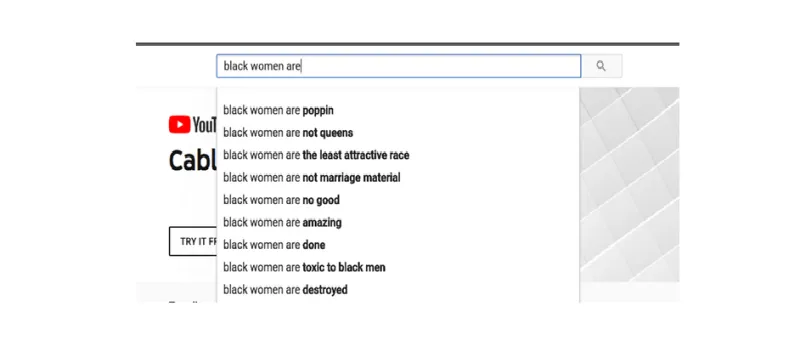

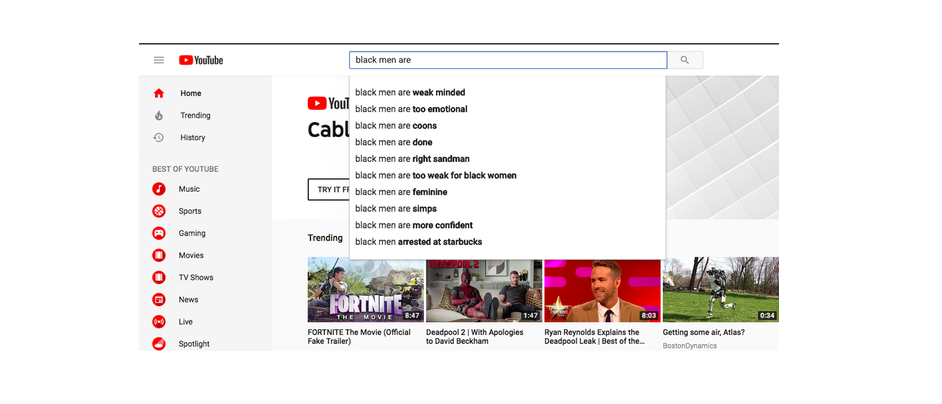

حسنا عند كتابة “black men are” أي "الرجال السود هم" تستغل خاصية الإكمال التلقائي لتعرض عددا من التعليقات من المؤسف أن معظمها اقتراحات عنصرية فحسب.

مثل "الرجال السود ضعيفو التفكير" ، "الرجال السود عاطفيون جدًا"، و "الرجال السود هم أغبياء" وهي التي تظهر بالإنجليزية “black men are weak minded" و “black men are too emotional” و “black men are coons”

مثل "الرجال السود ضعيفو التفكير" ، "الرجال السود عاطفيون جدًا"، و "الرجال السود هم أغبياء" وهي التي تظهر بالإنجليزية “black men are weak minded" و “black men are too emotional” و “black men are coons”

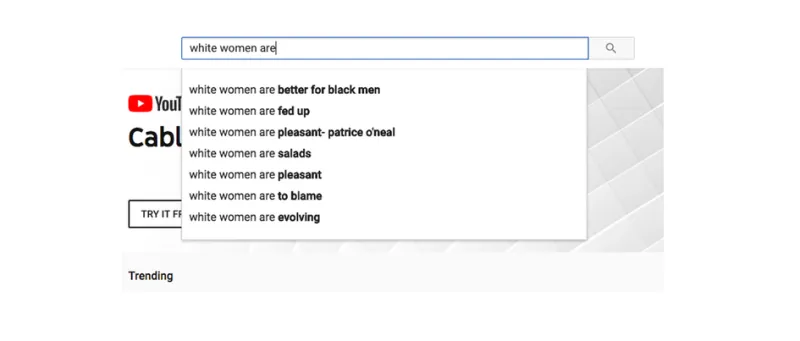

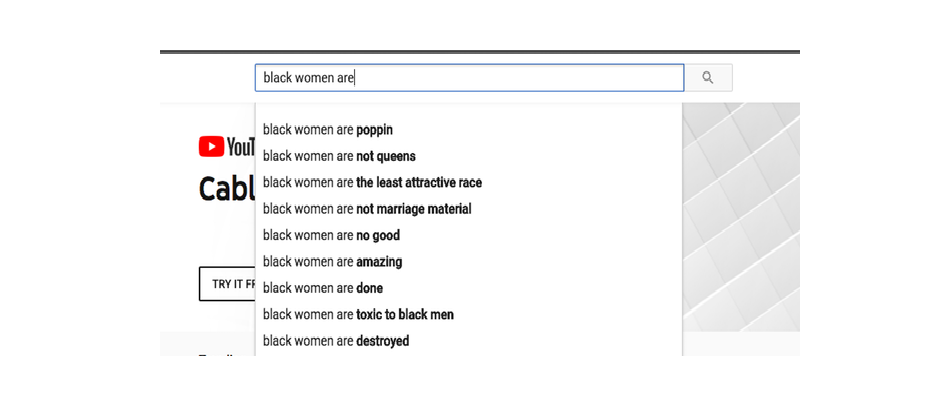

عند إجراء البحث حول النساء السوداوات وكتابة ذلك في مربع البحث تظهر عدة اقتراحات عنصرية أيضا منها "النساء السوداوات هن أقل عرق جذاب" و "النساء السوداوات لسن مواد للزواج" وهي التي تظهر بالإنجليزية كالتالي: "black women are not marriage material” و “black women are toxic to black men” و “black women are no good”.

كان البروفيسور والباحث جوناثان أولبرايت أول من اكتشف الاقتراحات وأكد على ذلك في تغريدة قام بكتابتها ونشرها على تويتر، وتظهر الاقتراحات حتى في وضع التصفح المتخفي أو الخاص، والذي يضمن عدم ارتباط نتائج البحث بسجل تصفح مستخدم معين. وتظل النتائج هي دون أي تغيير بغض النظر عن المتصفح أو الحساب أو الجهاز.

#نعم_أتغير.. أهم النصائح الطبية لمرضى الكلى في رمضان

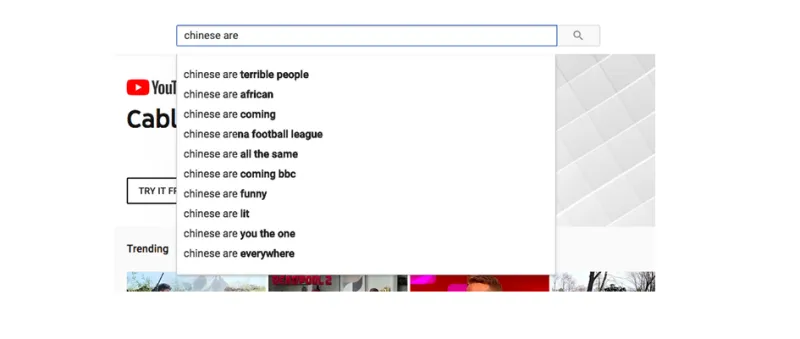

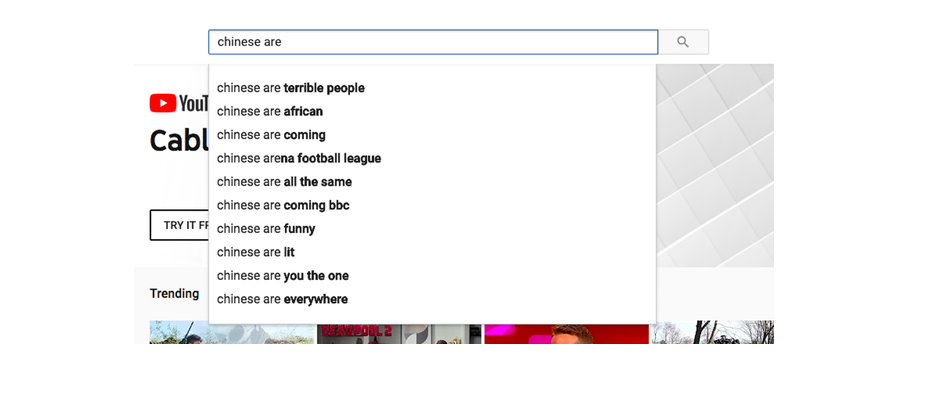

وأكد الباحث نفسه على أن البحث عن كلمة "صينيون" يؤدي إلى عرض اقتراحات سريعة ومقلقة، مثل "الصينيون أناس مروعون"، و "الصينيون أفارقة"، و "الصينيون كلهم متشابهون".

لم تكن أي من عمليات البحث هذه قابلة للتكرار تمامًا على الأنظمة الأساسية الأخرى جوجل، مثل محرك بحث جوجل، مما يثير السؤال عن سبب ظهور هذه النتائج على يوتيوب فقط. على الرغم من أن الشركة مشهورة بشدّة عندما يتعلق الأمر بالعمليات الداخلية لمنتجاتها وخوارزميات البحث، إلا أن جوجل قدّمت بعض التوضيحات حول طريقة عمل محرك بحث جوجل (الذي يختلف تقنيًا عن محرك بحث يوتيوب) وهذا من خلال تدوينة على مدونة الشركة في أبريل 2018. وجاء فيها: "إن التنبؤات التي نعرضها شائعة وتلك الشائعة تتعلق بما يبدأ شخص في كتابته".

أوضح داني سوليفان منسق الارتباط العام لمحرك بحث جوجل المزيد بالقول: "لدينا أنظمة مصممة لتكتشف تلقائيًا التوقعات غير الملائمة ولا تعرضها. ومع ذلك، فإننا نعالج المليارات من عمليات البحث في اليوم، وهذا بدوره يعني أننا نظهر العديد من بلايين التوقعات كل يوم. إن أنظمتنا ليست مثالية، ويمكن الحصول على توقعات غير لائقة".

يذكر ان هذه ليست المرة الأولى التي تخطئ فيها خاصية الاكمال التلقائي بمحرك بحث يوتيوب وتعرض اقتراحات سيئة للغاية، فبالعودة إلى نهاية العام الماضي، ظهر للكثير من المستخدمين اقتراحات لها علاقة بكيفية استغلال الأطفال جنسيا، حيث تعرض اقتراحات من قبيل "كيف تمارس الجنس مع ابنك" وما إلى غير ذلك من الاقتراحات المسيئة للأطفال ما جعل الشركة تتعرض للكثير من الانتقادات وتسحب تلك الاقتراحات.

للاعبي كمال الأجسام ..هذا ما عليكم معرفته عن رفع الأثقال في رمضان

على الرغم من قيام الشركة بإجراء العديد من التغييرات على أدواتها للتنبؤ وإعداد تقارير المستخدمين، إلا أنها لم تكن أبدًا مضمونة حقاً.

في أبريل 2018، أعلنت جوجل أنها ستوسع تعريفها لـ "التنبؤات غير الملائمة" في محاولة لإيقاف المستخدمين المسيئين خطأ، لكن يبدو أن مثل هذه النتائج تشير إلى أنه لا يزال أمامها الكثير من العمل.

بعد انتشار هذا الخبر أصدرت جوجل بيانا رسميا أكدت فيه على أنها ستقوم بإصلاح الوضع وأنها تجري حاليا تحقيقا داخليا مع العمل على إزالة تلك الاقتراحات العنصرية من محرك بحث يوتيوب.