خوارزمية الكشف عن الأخبار المزيفة متفوقة على البشر

عندما أدرك الباحثون الذين يعملون على تطوير أداة قائمة على التعلم الآلي للكشف عن الأخبار المزيفة أنه لم تكن هناك بيانات كافية لتدريب خوارزمياتهم، فقد فعلوا الشيء العقلاني الوحيد: قاموا بتجميع مئات المقالات الإخبارية المزيفة وتزود الآلة بها كي تتعرف عليها وتكون قادرة على تمييزها عن المقالات الإخبارية الصحيحة.

تستخدم الخوارزمية التي تم تطويرها من قبل باحثين من جامعة ميشيغان وجامعة أمستردام، معالجة اللغات الطبيعية (NLP) للبحث عن أنماط محددة أو إشارات لغوية تشير إلى أن مقالة معينة هي خبر مزيفة، يختلف هذا عن خوارزمية التحقق من الحقائق التي تشير إلى مقال مع أجزاء أخرى لمعرفة ما إذا كان يحتوي على معلومات غير متناسقة، يمكن لحلول التعلم الآلي هذه إجراء عملية الكشف بشكل كامل.

سعر ومواصفات Sony Xperia XZ3.. عيوب ومميزات هاتف سوني إكسبريا إكس زد 3

لكن هذا لا يشكل الإساءة إلى فريق ميتشيجان / أمستردام ولكن بناء خوارزمية البرمجة اللغوية العصبية لتحليل بنية الجملة والتركيز على الكلمات الرئيسية ليس بالضبط عمل الذكاء الاصطناعي الذي يمكنه القيام بأكثر من ذلك لاكتشاف الأخبار المزيفة ومع ذلك فإن اكتشافها في هذه الحالة أفضل من الإعتماد على الأشخاص.

المشكلة في ذلك هي أنه لا توجد بيانات كافية، لا يمكنك فقط تنزيل الإنترنت وإخبار خوارزمية لتحديد الأشياء: تحتاج الأجهزة إلى قواعد وأمثلة، تتضمن مجموعات البيانات المتوفرة عادةً لهذا النوع من التدريب واحدة تسمى مجموعة بيانات Buzzfeed، والتي تم استخدامها لتدريب خوارزمية للكشف عن الأخبار المزعجة المفرطة الحزبية على فيس بوك، مجموعات البيانات الأخرى تركز بشكل رئيسي على تدريب الذكاء الاصطناعي ضد الهجاء، للأسف هذه الطريقة تميل إلى مجرد جعل خوارزمية كاشف السخرية.

لذا، كان أول شيء على الباحثين فعله هو أن يقرروا ما هي الأخبار المزورة، لهذا تحولوا إلى "متطلبات لمزيج إخباري مزيف" طورها فريق من الباحثين من جامعة ويسترن أونتاريو.

التعليم الرقمي.. تجربة سعودية رائدة في إطار رؤية المملكة 2030

تشير هذه المتطلبات التسعة بشكل أساسي إلى أن خوارزمية الكشف عن الأخبار المزيفة يجب أن تكون قادرة على الكشف عن الأخبار الصحيحة أيضا، والتحقق من الحقائق وحساب عوامل مثل تطوير الأخبار واللغة والتفسيرات الثقافية، يمكنك قراءة المزيد عنها في الورقة البيضاء لفريق أونتاريو هنا.

خلاصة القول هي أن الأخبار المزيفة التي تتجادل حولها مع الأشخاص على تويتر قد تكون تقرير كاذب عمداً (يسمى تلفيقًا خطيرًا)، أو خدع (تم تصميمها بغرض نشوء الفيروسية على وسائل التواصل الاجتماعي) أو المقالات المقصودة كفكاهة أو هجاء.

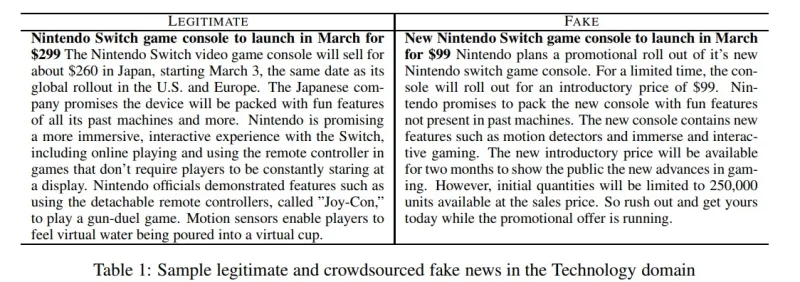

قام الباحثون بتحصيل مجموعة البيانات الخاصة بهم من خلال مطالبة عمال شركة Amazon Mechanical Turk بإعادة تفسير 500 قصة إخبارية حقيقية كقصص إخبارية مزيفة، وطُلب من المشاركين في الدراسة تقليد الأسلوب الصحفي للمقالة الأصلي، ولكنهم قاموا بتذليل الحقائق والمعلومات بما يكفي لضمان أن النتيجة كانت مزيفة بشكل واضح.

وقد قام الفريق بتغذية الأخبار المزيفة والأخبار الحقيقية بالخوارزمية، وعلمها كيفية التمييز بين الاثنين. وبمجرد أن تم تدريبها، قام الفريق بتغذية الأخبار مباشرة من مجموعة بيانات تحتوي على أخبار حقيقية ومزيفة مباشرة من الويب، وكانت أفضل من البشر حيث استطاعت التمييز بين الأخبار الصحيحة والمزيفة.

الأمر ليس مثالياً، فالخوارزمية تخطئ بنسبة 24 بالمائة من الوقت، لكن البشر يفسدون الأشياء بنسبة 30 بالمائة من الوقت، لذا فإن النقطة تذهب إلى الآلات والخوارزميات في هذه الحالة.

يقول القائمون على هذا المشروع أنه لم يصل إلى المثالية المنشودة، فلا يزال بإمكانه التغافل عن قصص اخبارية مزيفة أو اعتبارها صحيحة، لكن يمكن أن يساعد المدققين البشر على التدقيق في القصص أكثر واكتشاف الأخبار المزيفة.

من المرجح أنه لن يتم حل هذه المشكلة بمجرد عرض مصادر متعددة لنفس الخبر لمستهلك الأخبار والتدقيق البشري وحتى باعتماد هذه الخوارزمية الجديدة، لكنه سيقلل منها.

لماذا تستخدم شركات التكنولوجيا البشر لمساعدة الذكاء الاصطناعي؟

يتضمن الحل الأكثر أناقة والمقترح حاليا لتطوير المشروع تنفيذ البروتوكولات والحمايات على مستوى النشر والتجميع ومستوى النظام الأساسي ويمكن أن يتم ذلك بشكل تلقائي.

وفقًا للورقة البيضاء لفريق البحث، وصلت الخوارزمية إلى مستوى حيث أفضل نماذج الكمبيوتر أداءً "مماثلة لقدرة الإنسان على تحديد محتوى مزيف". لسنا متأكدين ما إذا كان هذا جيدًا بما فيه الكفاية للتخلص من المشكلة بالكامل لكنها بداية رائعة.

يمكن لفيس بوك والشبكات الإجتماعية ومنصات تداول الأخبار استخدام هذه الخوارزمية في المستقبل للمساعدة على رصد الأخبار المزيفة وحجبها.