«منشورك مخالف لسياساتنا».. كيف يُميز «فيسبوك» المحتوى المسيء؟

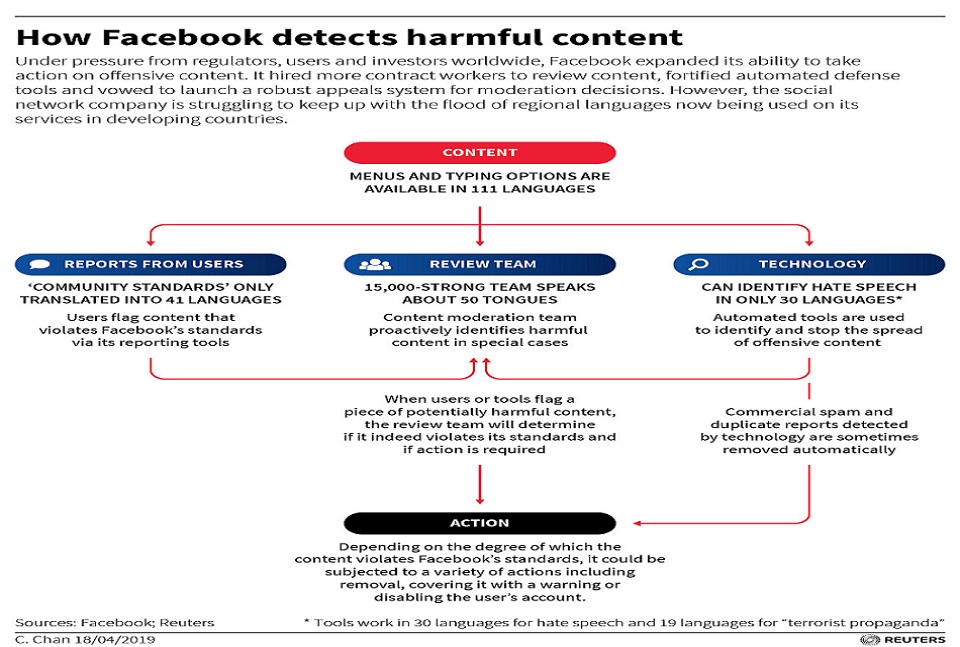

يتبادر إلى ذهن البعض تساؤل حول الآلية التي يرصد من خلالها «فيسبوك» المحتوي المسيء المخالف لسياسات نشره، ومن ثم حذفه خلال وقت قصير من نشره، وإجابة ذلك تكمن في أن فيسبوك يعتمد بالأساس على تقنية «التعلم الآلي»، ما ينتج عنه توازن يتماشى مع الكم الهائل من المنشورات المُقدر بالملايين الذي يتم بثه على المنصة يوميا، ويؤدي إلى تقليل الاستعانة بالعنصر البشري لمراجعة المحتويات المسيئة.

فيسبوك في أحدث تقرير لها عن مدى مطابقتها لمعايير المجتمع وحماية الحقوق العامة قالت: إن 98 % من المحتويات المسيئة بين صور ومقاطع فيديو تحوى عمليات إرهابية، أُزيلت على الفور قبل رؤيتها من أي مستخدم.

الذكاء الاصطناعي هو الحل

ذلك يعود بنا إلى توضيحات بشأن تقنية «التعلم الآلي» التي تتيح لفيسبوك مراقبة المحتوى المنشور على منصته، تتمحور الفكرة حول تدريب الأنظمة الذكية للشركة على مشاهدة أشياء معينة لمدد زمنية معينة ثم تستطيع فيما بعد التفرقة بينها، باستخدام الذكاء الاصطناعي تقوم بعرض مئات أو آلاف العناصر على تلك التقنية ، من عناصر ومشاهد عادية كالمنضدة أو المكتب أو الإنسان أو الأشجار، حتى الوصول للعناصر المصنفة خطر، كالأسلحة بمختلف أنواعها والذخائر وأفعال القتل والإيذاء بكافة صوره.

«فيسبوك» يصحح الأخبار الكاذبة..هل يؤثر ذلك على حرية التعبير؟

كيفية تحديد عناصر الخطورة وتغذيتها لتقنية التعلم الآلي، يكون عن طريق شبكات عصبية مستخدمة بتقنيات الذكاء الاصطناعي، تلك الشبكات ترصد السلوكيات والسمات المميزة لكل كائن يُعرض عليها وتحفظه في قاعدة البيانات الخاصة بها، ثم يتم تصنيف تلك البيانات بدرجات بناء على المعطيات المُدخلة من المراجعين، الذين يقومون بدورهم بتغذية الشبكات العصبية بصور ومقاطع فيديو لتدريبها على المحتويات المسيئة، ليصبح بإمكان التقنية رصد الفيديو والإبلاغ عنه دون الحاجة لمشاهدته بالكامل بناء على المعلومات المُدخلة إليها.

مطاردة المحتوى المسيء إلى غير رجعة

ذلك المنشور بعد أن يتم رصده بناء على كونه يحوى مادة مسيئة، قد يتم حذفه تلقائيا، أو إرساله من النظام إلى أحد مراجعي المحتوى والذي بدوره ما أن يتأكد من خرق المحتوى لقواعد فيسبوك، يقوم حينها بوسمه بسلاسل من الأرقام والرموز لتمييزه وإدخال تلك الرموز للنظام، فيحذفه تلقائيا من على المنصة في كافة أنحاء العالم ويستمر في ذلك حتى في حال حاول أحدهم تحميل المحتوى المسيء مرة أخرى.

تقنية فعالة ومفيدة، ولكنها – وفقا للإحصائيات – لا تمثل أكثر من 16 % من نسبة المنسورات المسيئة التي تقوم فيسبوك بحذفها، حيث تؤول النسبة الأكبر لمستخدمي المنصة الذين يبلغون عن تلك المحتويات لإدارة فيسبوك.